Apresentando o escore de prontidão para agentes. Seu site está pronto para agentes?

A web sempre teve que se adaptar a novos padrões. Aprendeu a se comunicar com navegadores da web e, em seguida, aprendeu a se comunicar com motores de busca. Agora, precisa se comunicar com agentes de IA.

Hoje, estamos empolgados em apresentar isitagentready.com — uma nova ferramenta para ajudar os proprietários de sites a entender como podem otimizar seus sites para agentes, desde orientar os agentes sobre como autenticar, até controlar quais conteúdos os agentes podem ver, o formato em que os recebem e como pagam por isso. Também estamos introduzindo um novo conjunto de dados no Cloudflare Radar que rastreia a adoção geral de cada padrão de agente na Internet.

Queremos liderar pelo exemplo. É por isso que também estamos compartilhando como recentemente reformulamos a Documentação para Desenvolvedores do Cloudflare para torná-la o site de documentação mais amigável para agentes, permitindo que ferramentas de IA respondam perguntas mais rapidamente e de forma significativamente mais barata.

A resposta curta: não muito. Isso é esperado, mas também mostra o quanto os agentes podem ser mais eficazes do que são hoje, se os padrões forem adotados.

Para analisar isso, o Cloudflare Radar pegou os 200.000 domínios mais visitados na Internet; filtrou categorias onde a prontidão para agentes não é importante (como redirecionamentos, servidores de anúncios e serviços de tunelamento) para se concentrar em empresas, editores e plataformas com as quais os agentes de IA podem realisticamente precisar interagir; e os escaneou usando nossa nova ferramenta.

O resultado é um novo gráfico de “Adoção de padrões de agentes de IA” que agora pode ser encontrado na página Cloudflare Radar AI Insights, onde podemos medir a adoção de cada padrão em várias categorias de domínio.

Analisando verificações individuais, algumas coisas se destacaram:

robots.txt é quase universal — 78% dos sites têm um — mas a grande maioria é escrita para crawlers de motores de busca tradicionais, não para agentes de IA.

Content Signals: 4% dos sites declararam suas preferências de uso de IA em robots.txt. Este é um novo padrão que está ganhando força.

A negociação de conteúdo Markdown (servindo texto/markdown em Accept: text/markdown) passa em 3,9% dos sites.

Novos padrões emergentes como MCP Server Cards e Catálogos de API (RFC 9727) aparecem juntos em menos de 15 sites em todo o conjunto de dados. Ainda é cedo — há muitas oportunidades para se destacar sendo um dos primeiros sites a adotar novos padrões e trabalhar bem com agentes.

Este gráfico será atualizado semanalmente, e os dados também podem ser acessados através do Data Explorer ou da Radar API.

Você pode obter uma pontuação de prontidão para agentes para seu próprio site acessando isitagentready.com e inserindo a URL do site.

Pontuações e auditorias que fornecem feedback acionável ajudaram a impulsionar a adoção de novos padrões anteriormente. Por exemplo, Google Lighthouse pontua sites com base nas melhores práticas de desempenho e segurança, e orienta os proprietários de sites a adotar os mais recentes padrões da plataforma web. Acreditamos que algo semelhante deve existir para ajudar os proprietários de sites a adotar as melhores práticas para agentes.

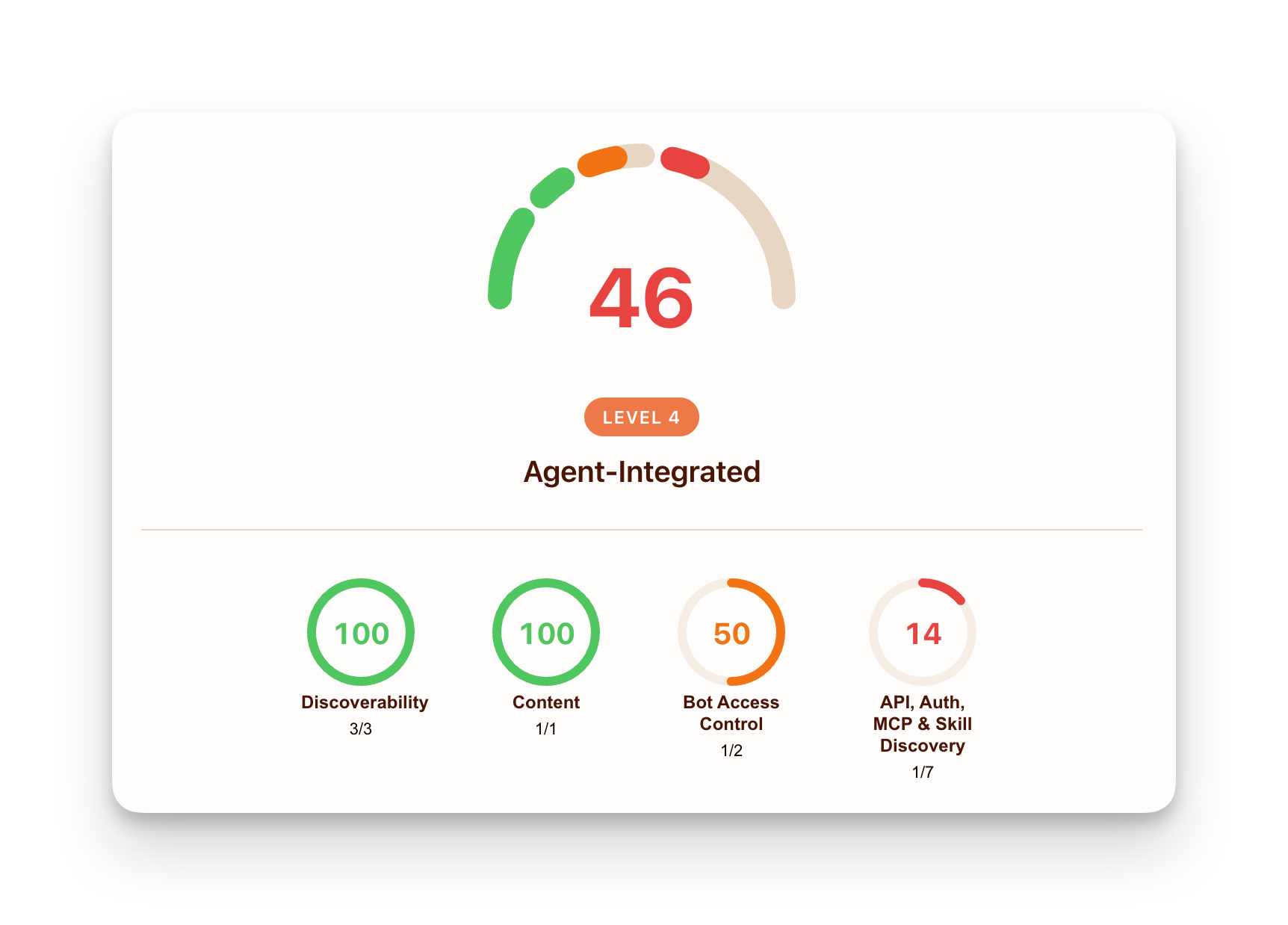

Quando você insere seu site, o Cloudflare faz solicitações a ele para verificar quais padrões ele suporta e fornece uma pontuação com base em quatro dimensões:

Descobribilidade: robots.txt, sitemap.xml, Link Headers (RFC 8288)

Conteúdo: Markdown para Agentes

Controle de Acesso de Bots: Content Signals, Regras de bots de IA em robots.txt, Autenticação de Bots Web

Capacidades: Habilidades de Agente, Catálogo de API (RFC 9727), descoberta de servidor OAuth via RFC 8414 e RFC 9728, MCP Server Card, e WebMCP

Captura de tela dos resultados de uma verificação de prontidão para agentes para um site de exemplo.

Além disso, verificamos se o site suporta padrões de comércio agentic, incluindo x402, Protocolo de Comércio Universal, e Protocolo de Comércio Agentic, mas estes atualmente não contam para a pontuação.

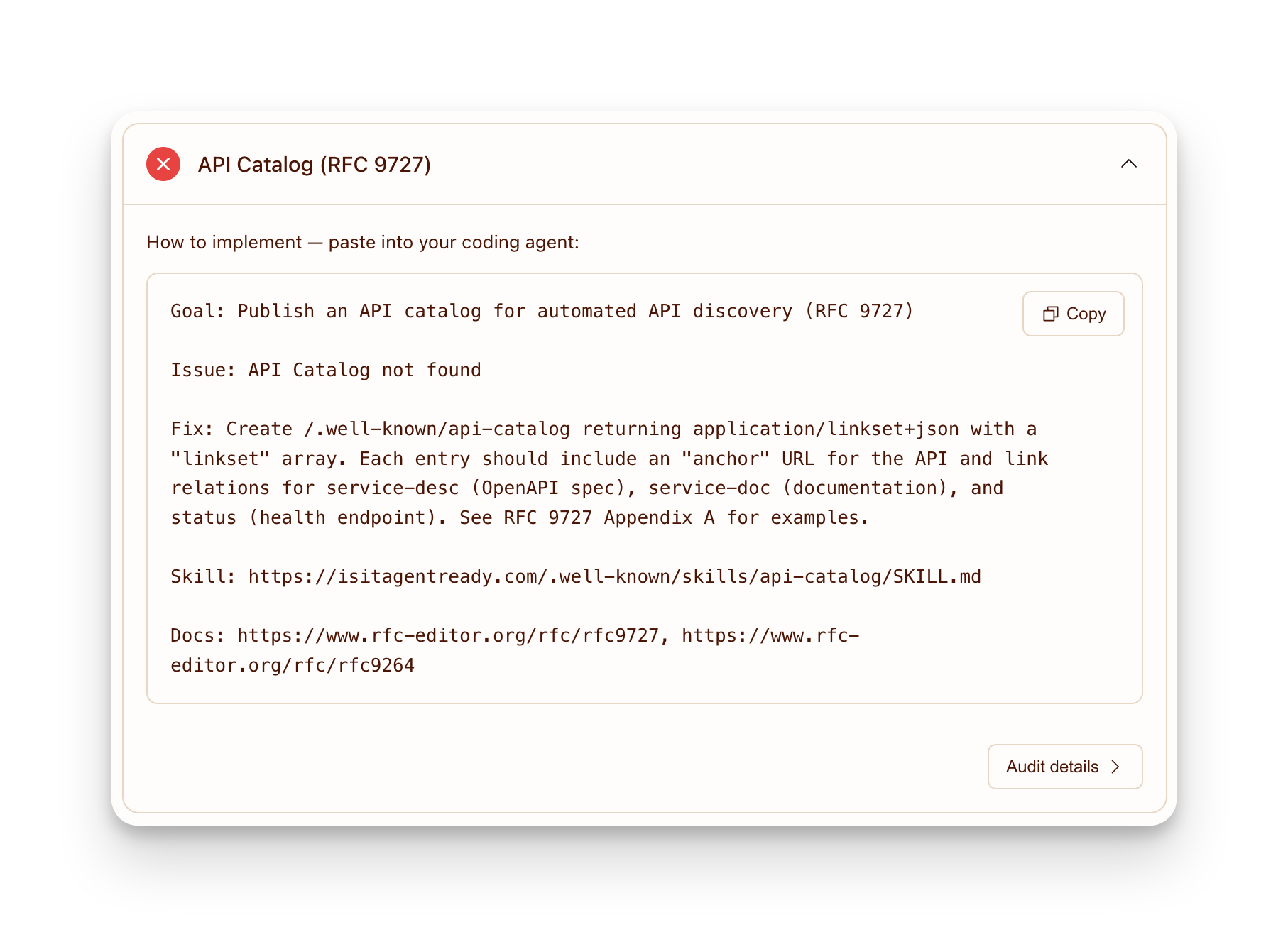

Para cada verificação que falha, fornecemos um prompt que você pode dar ao seu agente de codificação e pedir que implemente o suporte em seu nome.

O site em si também está preparado para agentes, praticando o que prega. Ele expõe um servidor MCP sem estado (https://isitagentready.com/.well-known/mcp.json) com uma ferramenta scan_site via HTTP Streamable, para que qualquer agente compatível com MCP possa escanear sites programaticamente sem usar a interface da web. Ele também publica um índice de Habilidades de Agente (https://isitagentready.com/.well-known/agent-skills/index.json) com documentos de habilidades para cada padrão que verifica, para que os agentes não apenas saibam o que corrigir, mas como corrigir.

Vamos explorar as verificações em cada categoria e por que elas são importantes para os agentes.

robots.txt existe desde 1994, e a maioria dos sites tem um. Ele serve a dois propósitos para os agentes: define regras de rastreamento (quem pode acessar o quê) e aponta para seus sitemaps. Um sitemap é um arquivo XML que lista cada caminho em seu site, essencialmente um mapa que os agentes podem seguir para dis

Com a crescente adoção de agentes de IA, é crucial que empresas brasileiras adaptem seus sites para atender a esses novos padrões. O escore de prontidão pode orientar melhorias, aumentando a eficiência e a interação com ferramentas de IA.